什么是监督式机器学习?

监督式机器学习定义

监督式机器学习,或监督学习,是一种机器学习(ML) 类型,用于人工智能 (AI) 应用,通过使用标记的数据集来训练算法。 通过向算法提供大型标记数据集,监督式机器学习“教导”算法准确预测结果。它是最常用的机器学习类型。

监督式机器学习,与所有机器学习一样,通过模式识别工作。通过分析一组特定的标记数据,算法可以检测模式,并在查询时根据这些导出的模式生成预测。为了达到准确的预测阶段,监督式机器学习的过程需要数据收集,然后进行标记。然后,使用此标记数据训练算法,以准确分类数据或预测结果。输出的质量与数据的质量直接相关:更好的数据意味着更好的预测。

监督式机器学习的示例范围从图像和对象识别到客户情感分析、垃圾邮件检测和预测分析。因此,监督式机器学习被用于医疗保健、金融和电子商务等多个行业,以帮助优化决策并推动创新。

监督式机器学习如何工作?

监督式机器学习的工作方式是收集和标记数据,然后训练模型,并使用新的数据集迭代该过程。这是一个两步过程:定义模型旨在解决的问题,然后是数据收集

- 步骤 1:定义模型旨在解决的问题。 模型是用于做出与业务相关的预测、自动化垃圾邮件检测、分析客户情绪还是识别图像?这决定了需要哪些数据,从而进入工作流程的下一步

- 步骤 2:收集数据。 一旦数据被标记,就会在训练中将其馈送到算法。然后对模型进行测试、改进和部署,以执行分类或回归任务。

数据收集和标记

收集数据是监督式机器学习的第一步。数据可以来自各种来源,例如数据库、传感器或用户交互。对数据进行预处理以确保一致性和相关性。收集后,将此大型数据集分配标签。输入数据的每个元素都会收到相应的标签。虽然数据分类可能既耗时又昂贵,但这是教导模型模式以便其进行预测所必需的。这些标签的质量和准确性直接影响模型学习和进行相关预测的能力。您的输出质量仅取决于您的输入质量。

模型训练

在训练期间,算法会分析输入数据,并学习将其映射到正确的输出标签。此过程涉及调整模型的参数,以最小化预测输出与实际标签之间的差异。模型通过从训练期间所犯的错误中学习来提高其准确性。一旦模型经过训练,就会进行评估。使用验证数据来确定模型的准确性。根据结果,然后根据需要对其进行微调。

理论上,模型吸收的数据越多,学习的模式就越多,预测就越准确。持续学习是机器学习的基石:模型性能会随着不断从标记数据集学习而变得更好。

部署后,监督式机器学习可以完成两种类型的任务:分类和回归。

分类依赖于算法来为给定的离散数据点或集合分配一个类。换句话说,它区分数据类别。在分类问题中,决策边界建立了类别。

回归 依赖于一种算法来理解连续的因变量和自变量数据之间的关系。在回归问题中,决策边界确定最佳拟合线或概率接近度。

监督式机器学习算法

在监督式机器学习中,针对分类和回归任务使用了不同的算法和技术,范围从文本分类到统计预测。

决策树

决策树算法是一种非参数监督学习算法,由根节点、分支、内部节点和叶节点组成。输入从根节点开始,通过分支到达内部节点,算法在内部节点处理输入并做出决策,输出叶节点。决策树可用于分类和回归任务。它们是很有用的数据挖掘和知识发现工具:它们允许用户追踪为什么产生输出,或者为什么做出决策。但是,决策树容易出现过拟合;它们难以处理更复杂的情况。因此,较小的决策树更有效。

线性回归

线性回归算法基于另一个变量(自变量)的值来预测一个变量(因变量)的值。预测基于变量之间线性关系的原理,或者连续变量(如薪水、价格或年龄)之间存在“直线”连接。线性回归模型用于在生物学、社会、环境、行为科学和商业领域进行预测。

神经网络

神经网络 使用由输入、权重、阈值(有时称为偏差)和输出组成的节点。这些节点分层排列在输入层、隐藏层和输出层的结构中,类似于人脑,因此称为神经。神经网络被认为是 深度学习算法,它们从标记的训练数据中构建知识库。因此,它们可以识别数据中复杂的模式和关系。它们是一个自适应系统,能够从错误中“学习”以持续改进。神经网络可用于图像识别和语言处理应用。

随机森林

随机森林算法是多个不相关的决策树算法的集合(或森林),这些算法被编程为从多个输出中产生单个结果。随机森林算法的参数包括节点大小、树的数量和特征的数量。这些超参数在训练之前设置。它们对自助抽样和特征随机性方法的依赖确保了决策过程中的数据可变性,并最终产生更准确的预测。这是决策树和随机森林之间的关键区别。因此,随机森林算法具有更高的灵活性——特征自助抽样有助于估计缺失值,从而确保在某些数据点缺失时的准确性。

支持向量机 (SVM)

支持向量机 (SVM) 最常用于数据分类,偶尔也用于数据回归。对于分类应用,SVM 构建一个决策边界,帮助区分或分类数据点,例如水果与蔬菜,或哺乳动物与爬行动物。SVM 可用于图像识别或 文本分类。

朴素贝叶斯

朴素贝叶斯是一种基于贝叶斯定理的概率分类算法。它假设数据集中的特征是独立的,并且每个特征或预测因子在结果中具有相同的权重。这种假设被称为“朴素”,因为它在现实场景中通常可以被反驳。例如,句子中的下一个单词取决于它之前的单词。尽管如此,每个变量的单一概率使朴素贝叶斯算法在计算上效率很高,尤其是在 文本分类 和垃圾邮件过滤任务中。

K 近邻

K 近邻,也称为 KNN,是一种监督学习算法,它使用变量的接近程度来预测输出。换句话说,它基于相似的数据点彼此靠近的假设。一旦在标记的数据上进行训练,该算法就会计算查询与其记忆的数据(即其知识库)之间的距离,并制定预测。KNN 可以使用各种距离计算方法(曼哈顿、欧几里得、闵可夫斯基、汉明)来建立预测所依据的决策边界。KNN 用于分类和回归任务,包括相关性排名、相似性搜索、模式识别和产品推荐引擎。

监督式机器学习的挑战和局限性

尽管监督式机器学习可以在预测中实现高精度,但它是一种资源密集型的机器学习技术。它依赖于昂贵的数据标记过程,需要大型数据集,因此容易出现过拟合。

- 标记数据的成本: 监督学习的主要挑战之一是需要大型、准确标记的数据集。这些标签的准确性与模型的准确性成正比,因此质量至关重要。这是一项耗时的工作,有时需要专家知识(取决于数据和模型的预期用途),反过来,这可能会非常昂贵。在医疗保健或金融等数据敏感且复杂的领域,获取高质量的标记数据集可能尤其具有挑战性。

- 需要大型数据集: 监督学习模型对大型数据集的依赖可能是一个重大挑战,原因有两个:收集和标记大量高质量数据是资源密集型的,并且在过多的数据和足够好的数据之间找到正确的平衡是很棘手的。大型数据集对于有效的训练是必要的,但是过于广泛的数据集会导致过拟合。

- 过拟合: 过拟合是监督学习中常见的担忧。当模型暴露于过多的训练数据并捕获噪声或不相关的细节时,就会发生过拟合——存在过多的数据这种情况。这会影响其预测的质量,并导致在新出现的、未见过的数据上的表现不佳。为了对抗或避免过拟合,工程师依赖于交叉验证、正则化或修剪技术。

预处理数据是这些挑战的核心。它可能既耗时又昂贵,但是通过正确的工具,它可以缓解成本、质量和过拟合带来的挑战。

监督式与非监督式机器学习

机器学习可以分为 监督式、非监督式和半监督式。每种数据训练方法都能实现不同的结果,并在不同的上下文中使用。监督式机器学习需要标记的数据集来训练数据,但由于大型、高质量的数据集,其准确性得到了提高。

相比之下,非监督式机器学习使用未标记的数据集来训练模型以进行预测。该模型自行识别未标记数据点之间的模式,有时会导致准确性降低。非监督式学习通常用于聚类、关联或降维任务。

半监督式机器学习

半监督式机器学习是监督式和非监督式学习技术的结合。半监督式学习算法在少量标记数据和大量未标记数据上进行训练。与标记示例较少的非监督式学习模型相比,这可以实现更好的结果。半监督式学习是一种混合方法,在标记大型数据集不切实际或成本高昂的情况下尤其有用。

了解这些机器学习方法之间的差异对于为手头的任务选择正确的解决方案至关重要。

使用 Elastic 轻松实现机器学习

机器学习从数据开始 — 这就是 Elastic 的用武之地。

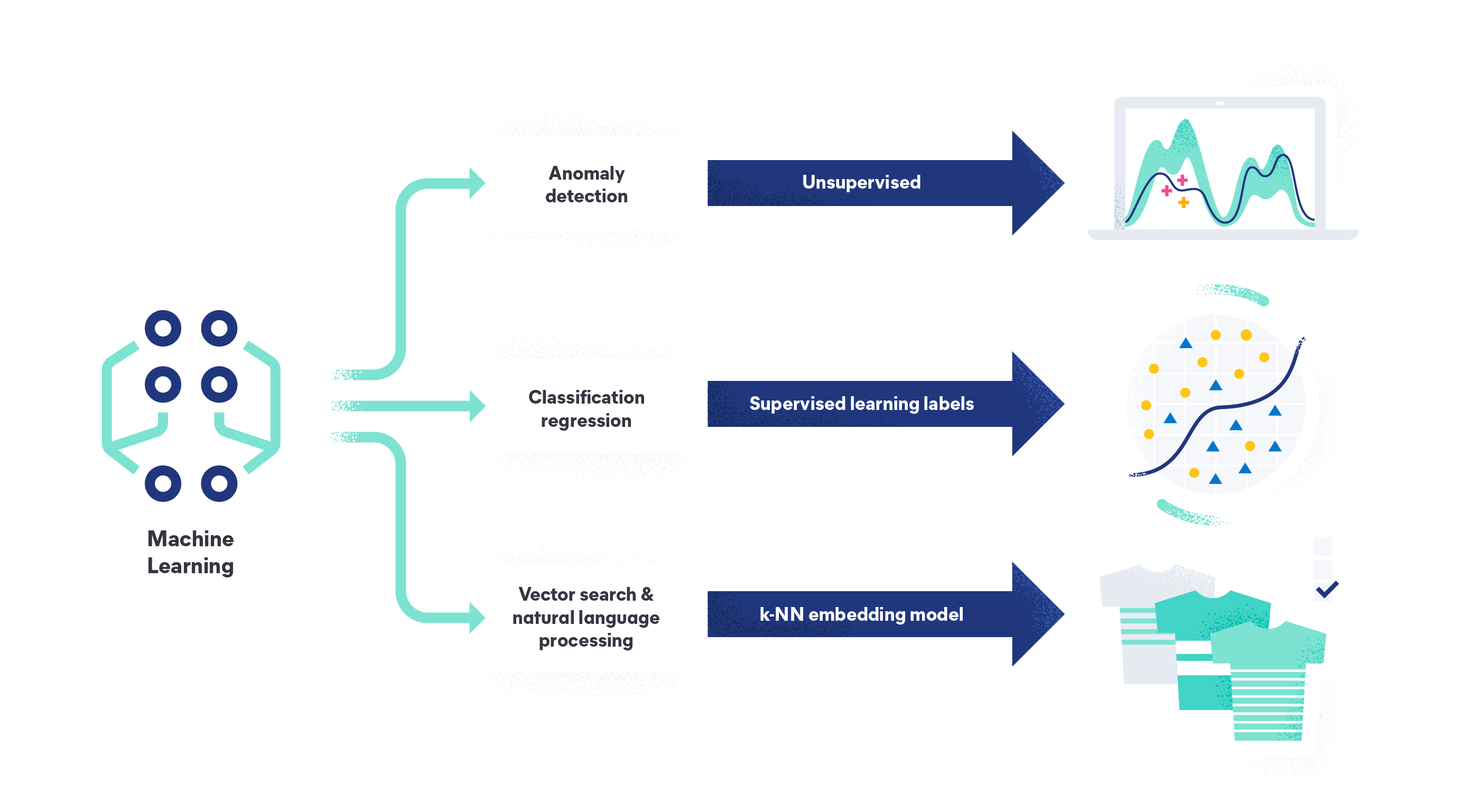

通过 Elastic 机器学习,您可以分析您的数据以查找异常,执行数据帧分析,并分析自然语言数据。Elastic 机器学习无需数据科学团队,无需从头设计系统架构,也无需将数据移动到第三方框架进行模型训练。作为搜索 AI 平台,我们的功能使您可以利用数据摄取、理解和构建模型,或者依靠我们开箱即用的非监督式模型进行异常和离群值检测。

详细了解 Elastic 如何通过 机器学习 帮助您解决数据挑战。